Hola Promptlers! 👋

Esta semana arrancamos con OpenAI, que ha publicado un documento pidiendo a Washington semanas de 32 horas, para prepararse ante la superinteligencia. Mientras tanto, Anthropic ha presentado Claude Mythos, un modelo tan potente en ciberseguridad que ya ha destapado miles de vulnerabilidades ocultas en los grandes sistemas operativos y navegadores. Y desde China, han presentado GLM-5.1, un modelo que supera a GPT y Claude en uno de los benchmarks de programación más exigentes del sector.

Además, al final te dejo el ⚡PrompTip y la 💊Píldora de IA para que no solo te enteres de las notícias, sino que salgas con algo práctico que puedas probar hoy.

En esta edición:

📅 OpenAI pide semana de 4 días, tasas a los robots y un fondo de riqueza nacional.

🛡️ Anthropic lanza Mythos y destapa bugs que llevaban décadas ocultos.

👨🏻💻 GLM-5.1, el modelo open source chino que supera a GPT y Claude en programación.

⚡ Noticias breves: OpenAI, Anthropic y Google se alían contra la copia china, Anthropic compra Coefficient Bio, OpenAI prueba Image V2, Anthropic bloquea OpenClaw y Meta lanza Muse Spark.

💡 PrompTip: Evalúa cómo la IA afectará tu puesto de trabajo.

💊 Píldora de IA: La web ya es una trampa para los agentes de IA.

OpenAI ha publicado un documento pidiendo a Washington que se prepare para la superinteligencia pidiendo un fondo de riqueza nacional, impuestos al trabajo automatizado y semanas laborales de 32 horas sin recorte salarial.

Lo esencial:

El documento propone crear un fondo público financiado en parte por empresas de IA que pagaría dividendos directos a cada ciudadano.

OpenAI plantea trasladar la carga fiscal del trabajo humano al capital. Más impuestos a las ganancias corporativas y a los beneficios generados por automatización.

Incluye una tasa directa al trabajo de robots.

Altman comparó la situación con el New Deal de los años 30. La empresa, valorada en 852.000 millones de dólares, presenta las ideas como punto de partida mientras prepara su salida a bolsa.

Anthropic ha presentado Claude Mythos, su modelo más potente hasta la fecha, y lo ha puesto al servicio de la ciberseguridad con Project Glasswing, una coalición con AWS, Apple, Google, Microsoft, NVIDIA y otros 12 socios para encontrar y corregir vulnerabilidades en software crítico.

Lo esencial:

Mythos identificó de forma autónoma miles de vulnerabilidades en todos los principales sistemas operativos y navegadores.

Anthropic considera que sus capacidades ofensivas son demasiado potentes y el modelo no se lanzará al público.

Anthropic destina 100 millones en créditos de uso y 4 millones en donaciones a organizaciones de seguridad open source.

Las capacidades de Mythos no fueron entrenadas específicamente para ciberseguridad si no que emergieron como consecuencia de mejoras generales en código y razonamiento.

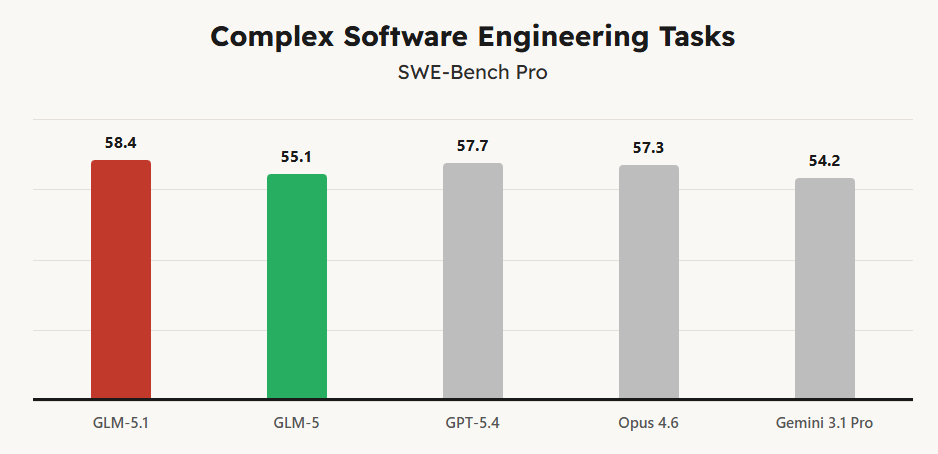

El laboratorio chino Z.ai ha lanzado GLM-5.1, un modelo de código abierto que lidera SWE-Bench Pro con 58.4 puntos, superando a GPT-5.4 (57.7) y Claude Opus 4.6 (57.3) en uno de los benchmarks de programación más exigentes del sector.

Lo esencial:

El modelo tiene 754.000 millones de parámetros, y fue entrenado íntegramente con chips Huawei Ascend, sin hardware de NVIDIA.

Puede trabajar hasta 8 horas seguidas en una tarea de programación, iterando, probando y corrigiendo sin intervención humana.

Ofrece acceso por API a $1,40/$4,40 por millón de tokens, una fracción del coste de los modelos propietarios.

La ventaja sobre Claude es de 1,1 puntos en SWE-Bench Pro pero en el compuesto más amplio de benchmarks de código, Claude Opus 4.6 sigue por delante.

⚡ Notícias Breves ⚡

🤝 OpenAI, Anthropic y Google se alían para frenar la copia masiva de sus modelos por laboratorios chinos.

🧬 Anthropic compra Coefficient Bio por 400 millones de dólares en acciones para reforzar su división de salud.

🖼️ OpenAI prueba Image V2, su modelo de generación de imágenes de nueva generación.

🛑 Anthropic bloquea OpenClaw dentro de las suscripciones de Claude Code y obliga a pagar por separado las integraciones con plataformas de agentes.

🧠 Meta lanza Muse Spark, su primer modelo de Meta Superintelligence Labs con razonamiento multimodal y orquestación multi-agente.

💡 PrompTip 💡

💡Evalúa cómo la IA afectará tu puesto de trabajo

OpenAI acaba de pedir a Washington que prepare semanas laborales de 4 días porque cree que la IA va a cambiar radicalmente cómo trabajamos. En lugar de esperar a que pase, usa este prompt para analizar tu situación concreta.

Pega el siguiente Prompt (cópialo tal cual):

Actúa como un consultor experto en transformación digital y mercado laboral.

Mi puesto de trabajo es: [DESCRIBE TU PUESTO, SECTOR Y TAREAS PRINCIPALES]

Mi nivel de uso actual de IA es: [NINGUNO / BÁSICO / INTERMEDIO / AVANZADO]

Quiero que analices mi rol frente al impacto de la IA. Sigue esta estructura:

1. DIAGNÓSTICO (máximo 5 bullets):

- Clasifica mis tareas diarias en tres categorías: automatizable a corto plazo, asistible por IA, y difícilmente sustituible. Sé específico.

2. RIESGO Y OPORTUNIDAD:

- Evalúa del 1 al 10 el riesgo de que mi rol cambie significativamente en los próximos 2 años.

- Identifica 3 oportunidades concretas donde la IA podría hacerme más productivo o valioso.

3. PLAN DE ACCIÓN (90 días):

- Dame 5 acciones concretas ordenadas por prioridad, con herramientas específicas que debería aprender y tiempo estimado de dedicación semanal.

Sé directo y honesto. Prefiero un análisis realista a uno optimista.💊 Pildora de IA 💊

Usamos agentes de IA para investigar, navegar y leer documentos por nosotros. Pero un estudio de Google DeepMind demuestra que ese entorno ya está siendo manipulado. Los investigadores identifican seis tipos de ataques que llaman AI Agent Traps: webs que detectan si el visitante es un agente y le sirven contenido distinto al que vería un humano.

Lo hacen mediante instrucciones ocultas en comentarios HTML, texto invisible en CSS, comandos en los píxeles de una imagen. En pruebas hechas en el estudio, estas inyecciones secuestraron el comportamiento del agente en el 86% de los casos.

Lo peor es el efecto cadena donde si un agente comprometido pasa datos a otro, la instrucción maliciosa viaja con él. Cuanta más autonomía damos a estos sistemas, más expuestos estamos a ataques que no van contra el modelo sino contra lo que consume.

Si quieres leer el artículo completo, Aquí.

AI Agents Are Reading Your Docs. Are You Ready?

Last month, 48% of visitors to documentation sites across Mintlify were AI agents, not humans.

Claude Code, Cursor, and other coding agents are becoming the actual customers reading your docs. And they read everything.

This changes what good documentation means. Humans skim and forgive gaps. Agents methodically check every endpoint, read every guide, and compare you against alternatives with zero fatigue.

Your docs aren't just helping users anymore. They're your product's first interview with the machines deciding whether to recommend you.

That means: clear schema markup so agents can parse your content, real benchmarks instead of marketing fluff, open endpoints agents can actually test, and honest comparisons that emphasize strengths without hype.

Mintlify powers documentation for over 20,000 companies, reaching 100M+ people every year. We just raised a $45M Series B led by @a16z and @SalesforceVC to build the knowledge layer for the agent era.

Si te ha gustado la newsletter, !Compártela!

Si te ha gusta Promptly ayúdanos a seguir creciendo compartiendo la newsletter con amigos, familiares e incluso en tus redes sociales. Te estaremos infinitamente agradecidos🙏!

Mil gracias por el apoyo y por seguir leyéndonos.

¡Nos vemos la próxima semana!

El Equipo de Promptly.